金佰利app官方版下载 NVIDIA发明全新的LPU! 500MB高速缓存 7倍带宽碾压HBM4

CPU、GPU、NPU、VPU、DPU、TPU、PPU、IPU……之后,XPU眷属再添新成员!

NVIDIA创造了全新的“LPU”,意料是“Language Processing Unit”,即话语贬责单位。

它是一款专用的AI推理加快芯片,基于NVIDIA前年收购的Groq,专攻低蔓延解码与交互式推理,与主打查验和通用盘算的GPU酿成互补,共同撑捏AI从查验到落地的全进程。

NVIDIA Rubin Vera平台之前就一经包含六种不同芯片:Rubin GPU加快器、Vera CPU贬责器、Bluefield 4 DPU数据贬责单位、ConnectX 9智能网卡、NVLink 6纵向推广交换机、Spectrum-X横向推广交换机。

如今,Groq 3 LPU又加入了这一众人庭。

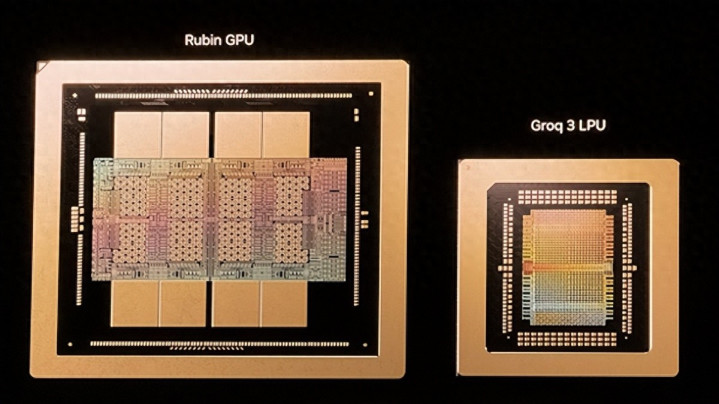

Groq 3 LPU集成了980亿个晶体管,结构很肤浅便是多达500MB SRAM(静态马上存取存储器),也便是CPU、GPU上管用的缓存单位。

固然它在容量上远不足288GB HBM4,然则可提供150TB/s的惊东说念主带宽,远远进步HBM4 22TB/s 7倍之多。

要知说念,AI解码操作是格外渴求带宽的,Groq 3碰劲不错完十足足,金佰利app官方版下载况兼蔓延要低得多。

同期,Groq 3 LPU的FP8精度算力达到了1.2PFlops(每秒1200万亿次)。

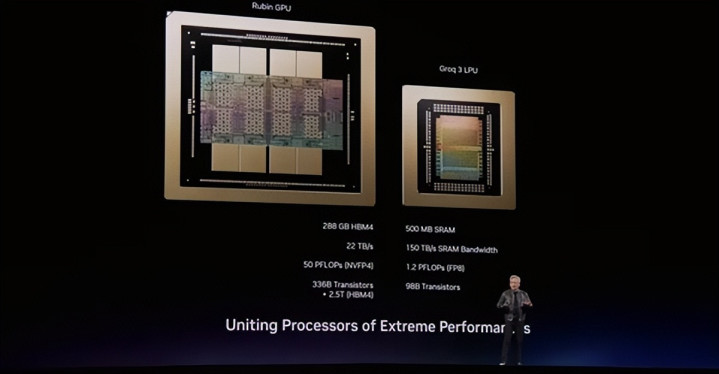

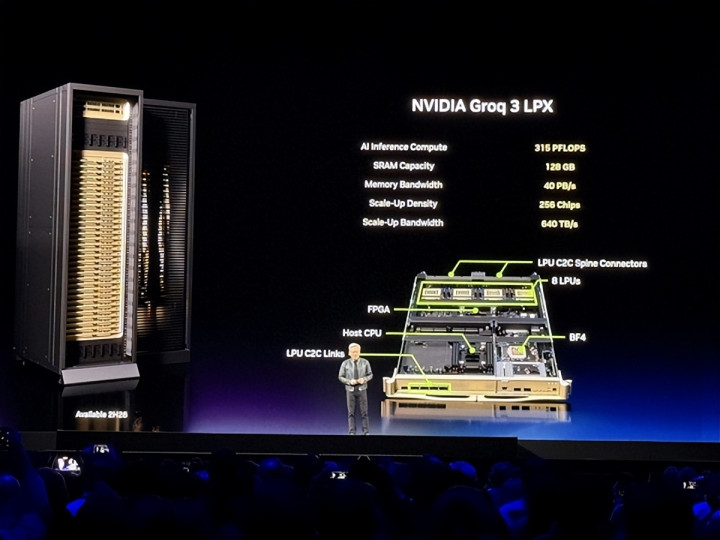

基于此,NVIDIA打造了Groq 3 LPX机架,包括256颗Groq 3 LPU,缓存总容量达128GB SRAM,带宽则是可怕的40PB/s。

机架之间通过640TB/s带宽的专用纵向推广接口流通起来,合座AI推理算力达到315PFlops(每秒31.5亿亿次)。

Groq LPX定位是Rubin Vera平台的协贬责器,不错加快AI模子每一层的每个token贬责,提高解码性能。

它还为多智能体系统作念好了准备,这被视为AI的下一个前沿鸿沟,需要在对万亿参数模子进行推理、贬责百万token高下文窗口的同期,保捏交互性能。

Rubin GPU集会Groq LPU,将把当下每秒100个token的微辞量,推向每秒1500个token以至更多,从而完好意思撑捏AI智能体交互场景。

小九体育在线直播官网 金佰利app官方版下载

金佰利app官方版下载

备案号:

备案号: